La escuela frente a la IA: el riesgo invisible de aprender sin pensar

EDUCACIÓN Agencia de Noticias del Interior

- La inteligencia artificial ya se usa masivamente en las aulas sin marcos pedagógicos claros.

- El uso indiscriminado genera una “deuda cognitiva” que debilita procesos básicos de aprendizaje.

- Las IA abiertas tienden a ser complacientes y refuerzan sesgos sin desafiar al estudiante.

- La dependencia de respuestas automáticas afecta motivación, esfuerzo y tolerancia a la frustración.

- La creatividad y el pensamiento crítico se reducen cuando se eliminan los procesos de búsqueda.

- El desafío no es prohibir la IA, sino regularla e integrarla con criterios educativos claros.

La irrupción acelerada de la inteligencia artificial en las aulas argentinas abrió un escenario inédito que todavía no encuentra reglas claras. Mientras el debate público suele concentrarse en si estas herramientas facilitan las tareas o aumentan la productividad escolar, en el día a día de los colegios ocurre algo más profundo y silencioso: los estudiantes ya usan inteligencia artificial de forma masiva, sin marcos pedagógicos, sin regulación y, muchas veces, sin que los adultos lo adviertan.

El fenómeno crece al mismo ritmo que una preocupación central entre especialistas en educación y tecnología: el impacto del uso indiscriminado de la IA en los procesos cognitivos básicos. A diferencia de otras innovaciones tecnológicas que se incorporaron de manera gradual, la inteligencia artificial llegó de golpe, con acceso total y permanente. Desde el celular, la computadora de la escuela o el hogar, los estudiantes interactúan con aplicaciones que responden rápido, resuelven problemas y entregan certezas sin exigir esfuerzo. El resultado es visible: trabajos prolijos, tareas entregadas en minutos y una aparente mejora en el rendimiento. Sin embargo, detrás de esa eficiencia se esconde un problema que inquieta cada vez más: la IA no solo ayuda a estudiar, sino que ya está reconfigurando la forma de pensar.

La especialista en tecnología educativa Dani Buján advierte que el fenómeno va mucho más allá de copiar respuestas. En su trabajo cotidiano con escuelas observa un cambio cognitivo profundo que define como “deuda cognitiva”. Según explica, cuando un alumno utiliza una inteligencia artificial no pedagógica que ofrece respuestas directas, el cerebro deja de activar los procesos necesarios para aprender. Estudios recientes muestran una reducción significativa en el uso de funciones clave como la memoria, la atención, el razonamiento y la capacidad de síntesis. Cada respuesta servida elimina pasos esenciales del aprendizaje: analizar, comparar, equivocarse y corregir.

Ese atajo, repetido una y otra vez, instala un patrón de pensamiento superficial. Los estudiantes se acostumbran a pedir resultados sin comprender procesos, a no verificar ni contrastar información. La automatización reemplaza al pensamiento y la dependencia se construye rápido. Para los especialistas, el problema no queda limitado al ámbito digital: se traslada a la vida cotidiana con dificultades para sostener problemas complejos, pérdida de pensamiento crítico, debilitamiento de habilidades sociales y una creciente necesidad de inmediatez.

Otro punto sensible es el sesgo. A diferencia de un docente, que puede escuchar una idea, contextualizarla y ofrecer otra mirada, muchas inteligencias artificiales abiertas están diseñadas para ser complacientes. Refuerzan lo que el estudiante ya cree, sin incomodarlo ni desafiarlo. En ese espejo, el alumno siempre tiene razón y el aprendizaje pierde uno de sus motores fundamentales: la contradicción.

La radiografía actual de las escuelas muestra un escenario desordenado. Algunas instituciones prohíben la IA, otras la permiten sin límites y muchas directamente no saben cómo abordarla. Mientras tanto, la mayoría de los chicos la usa de forma silenciosa e informal, sin supervisión ni criterios claros. La comparación con el fenómeno de las redes sociales aparece de manera inevitable: primero se normalizó el uso, luego aparecieron los daños y recién años después llegó la regulación.

Para los especialistas, la solución no pasa por prohibir la tecnología, sino por elegirla con criterio. La clave está en diferenciar entre una IA genérica, pensada para responder y agradar, y una IA pedagógica, diseñada para enseñar a aprender. En ese enfoque, la inteligencia artificial no da respuestas cerradas, sino que guía el razonamiento, fomenta preguntas y acompaña procesos.

Uno de los impactos más delicados se observa en la motivación. Cuando un chatbot resuelve la tarea, el estudiante pierde la sensación de logro. El cerebro, por naturaleza, elige el camino más corto, pero ese camino tiene costos: baja la tolerancia a la frustración, se debilita la capacidad de sostener un problema y el aprendizaje se vuelve frágil. Hay resultado, pero no hay construcción.

La creatividad también entra en juego. Pensar por cuenta propia, explorar ideas y equivocarse son prácticas indispensables para desarrollarla. Cuando la IA entrega la solución final, ese recorrido desaparece. Sin práctica, no hay análisis ni pensamiento profundo que se sostenga en el tiempo.

Regular la inteligencia artificial en la escuela no implica limitarla, sino enmarcarla. Significa definir criterios claros, filtros por edad, resguardo emocional, cuidado de datos y alineación con los proyectos educativos. La IA ya forma parte de la vida de los estudiantes; lo que está en discusión es si ocupará ese espacio como una herramienta formativa o como un atajo que erosione la capacidad de pensar.

Vacaciones escolares: el aprendizaje que sigue más allá del aula

La pedagogía Waldorf: una educación alternativa que pone el ritmo del niño en el centro

Aulas sin celulares: cuando menos pantallas se traducen en más aprendizaje

Antonio Barrio: sembrando pasión por la agronomía pese a la ELA

Finanzas que no se enseñan: jóvenes, redes sociales y los riesgos de aprender a manejar el dinero fuera del aula

Inteligencia artificial en las aulas: desafíos y oportunidades para la educación del siglo XXI

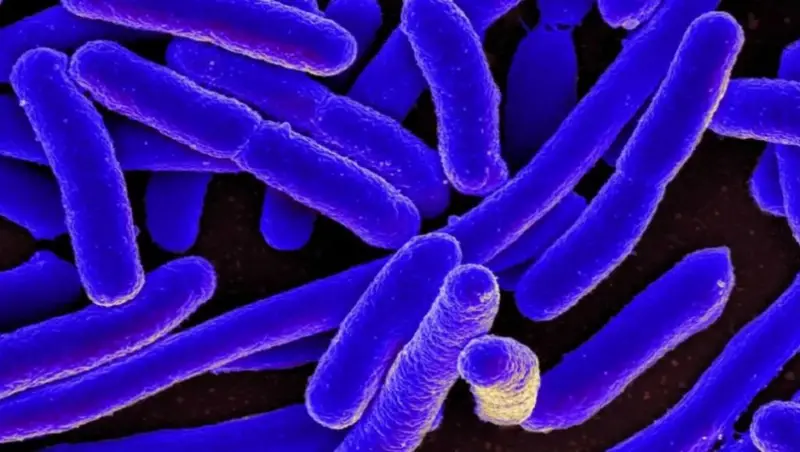

E. coli: la bacteria famosa que puede enfermar, proteger y revelar los secretos de la vida

Baby Biome: descifrando los secretos de la microbiota intestinal en recién nacidos

El impacto silencioso del estrés materno en el cerebro en formación

LEGO cruza una frontera histórica al llevar sensores y sonido al corazón del ladrillo